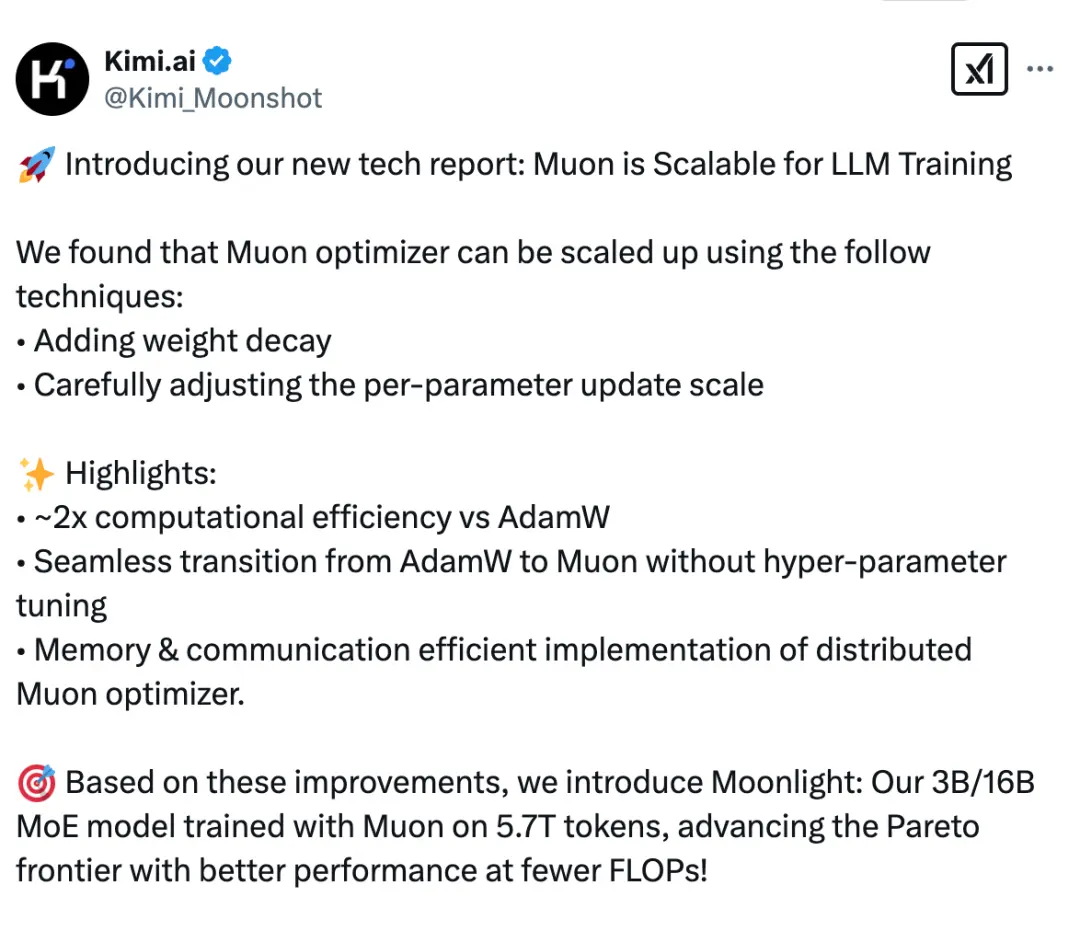

Moonlight是什么?

Moonlight 是由月之暗面公司推出的开源 MoE(Mixture of Experts)语言模型,,使用 Muon 优化器训练,激活参数仅需 3B。该模型在训练效率和性能上表现出色,训练 FLOPs 明显减少,同时支持 64K 上下文处理能力。它适用于多种自然语言处理任务,包括语言理解和生成。

Moonlight的主要特性

- 高效计算与稀疏激活:Moonlight 采用 MoE 架构,通过仅激活部分专家网络来处理输入,显著降低了计算成本和推理时间。这种稀疏激活机制使得模型在处理复杂任务时更加高效。

- 大规模训练优化:Moonlight 使用 Muon 优化器进行训练,该优化器通过矩阵化的更新规则和奇异值分解(SVD)技术,提升了训练效率和稳定性。与 AdamW 相比,Muon 在训练效率上提升了约 2 倍。

- 高上下文长度支持:Moonlight 支持较长的上下文长度(如 32k tokens),使其能够处理更复杂的语言任务。

- 灵活的专家配置:模型包含多个专家网络,每个专家专注于不同的任务,通过路由器选择性地激活相关专家,从而实现高效的任务处理。

- 开源与可扩展性:Moonlight 模型开源,支持多种应用场景,包括自然语言处理、文本生成和对话系统。

如何使用Moonlight模型?

月之暗面开源了Moonlight模型,以下是资源链接:

- 代码:https://github.com/MoonshotAI/Moonlight

- 模型:https://huggingface.co/moonshotai

- 论文:https://github.com/MoonshotAI/Moonlight/blob/master/Moonlight.pdf

©版权声明:如无特殊说明,本站所有内容均为AIHub.cn原创发布和所有。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。否则,我站将依法保留追究相关法律责任的权利。