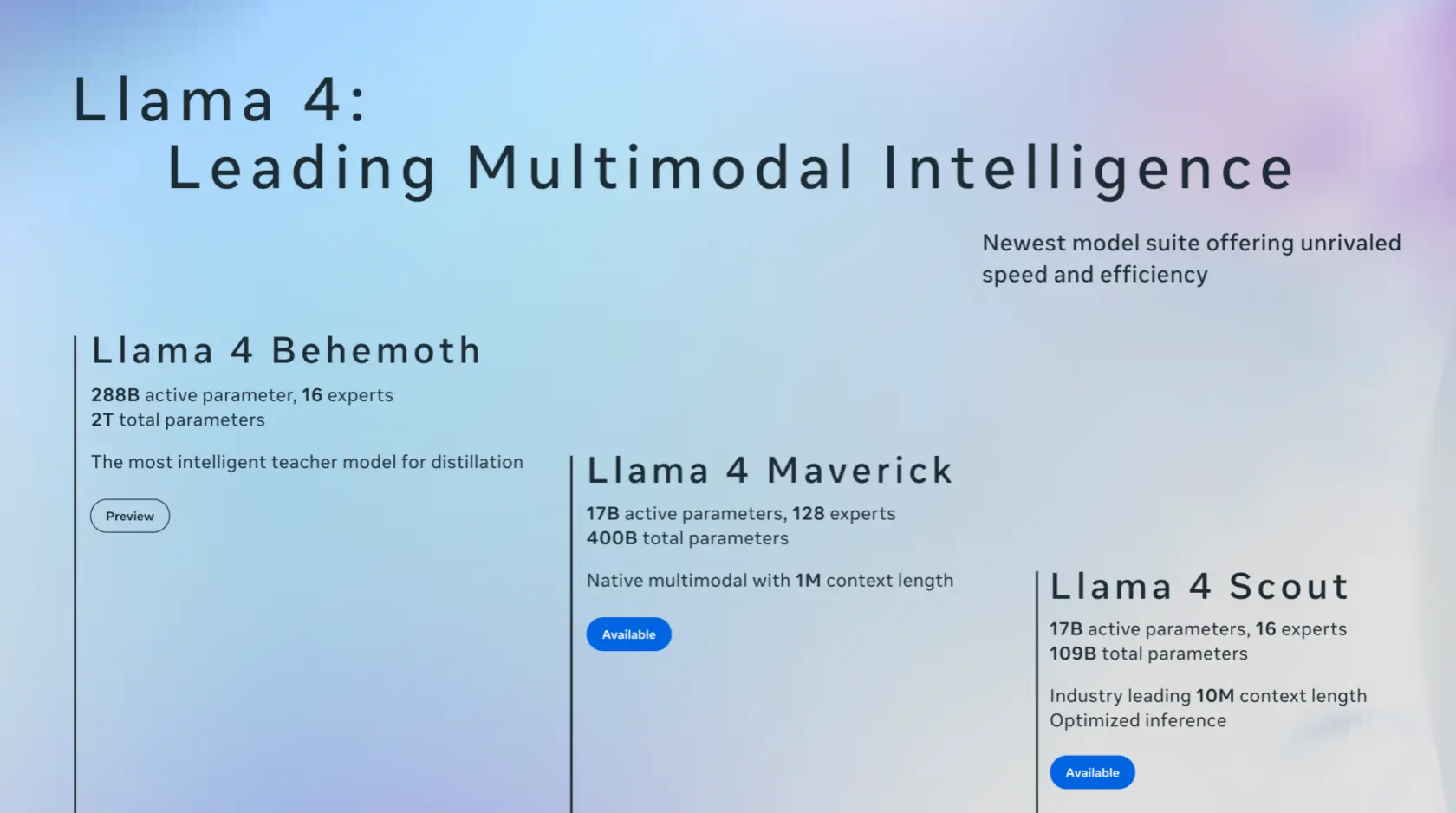

Llama 4 是什么?

Llama 4 是 Meta 发布的最新一代开源大模型,包含Llama 4 Scout 、Llama 4 Maverick 和Llama 4 Behemoth 3个版本,具备原生多模态能力,可处理文本和图像的联合输入,支持图文问答、多图理解等复杂任务。模型采用高效的 MoE(混合专家)架构,推理速度更快、成本更低,且上下文窗口长达 1000 万 tokens,远超同类模型。Llama 4 在代码生成、图像理解、数学推理等任务上的表现优于 GPT-4o 和 Gemini 2.0,被视为当前最强开源大模型之一,现已全面开放下载和部署。

Llama 4 包含的三个模型

| 模型名称 | 参数规模 | 模型类型 | 核心特点 |

|---|---|---|---|

| Llama 4 Scout | 17B 活跃参数 / 109B 总参数 | 多模态 / MoE | 单卡可运行,上下文支持 1000 万,图文理解出色 |

| Llama 4 Maverick | 17B 活跃参数 / 400B 总参数 | 多模态 / MoE | 支持图文生成、推理、代码,多项评测超越 GPT-4o |

| Llama 4 Behemoth(预览) | 288B 活跃参数 / 近 2T 总参数 | 多模态 / 教师模型 | STEM 能力领先,是内部 distill 教师模型 |

Llama 4 的主要特点

1. 原生多模态设计

Llama 4 支持图文(文字 + 图片)联合输入,是 Meta 首个「原生多模态」开源模型,具备以下特点:

- 图文早期融合(Early Fusion)

- 支持多张图像理解(实测最高支持 8 张图)

- 图像定位能力强,适用于 VQA(图像问答)、图文联想等任务

2. 超长上下文处理能力

- Llama 4 Scout 支持最长 10,000,000 tokens 上下文窗口

- 使用创新架构 iRoPE(interleaved Rotary Position Embedding)

- 适合多文档总结、长代码理解、搜索增强生成(RAG)

3. MoE 架构加速推理

- 使用混合专家机制(Mixture of Experts)提升效率与性能

- 每次只激活部分参数,推理成本更低、速度更快

- Maverick 模型使用 128 个专家 + 共享专家,实际部署可落地单张 H100 卡

4. 训练策略更先进

- 大量使用多语言数据(200+种语言,100亿级 token)

- 使用 FP8 精度训练 + 自研超参数设定策略(MetaP)

- 高效蒸馏:Llama 4 Maverick 从 Behemoth 模型 distill 得到,质量显著提升

5. 安全与公平性

- 集成了 Llama Guard、Prompt Guard 等安全机制

- GOAT 自动化红队测试框架上线,应对对抗性攻击

- 相比 Llama 3 拒答率大幅下降,政治立场更中立、响应更平衡

Llama 4 的性能评测

- 对话能力强

- Llama 4 Maverick 在 LMArena 得分 1417,超过 Claude 3 Sonnet、GPT-4o 等主流模型

- 多轮问答、指令理解表现优异

- 图像理解表现出色

- 原生多模态支持图文输入,多图处理能力强(最多支持 8 张图)

- 在 VQAv2、MMBench 等评测中超过 GPT-4o、Gemini Flash

- 数学与推理能力稳定提升

- 在 GSM8K、MATH 等测试中表现接近 GPT-4 Turbo

- 步骤推理清晰,符号理解能力强

- 代码能力扎实

- 支持多语言代码生成和多轮代码补全

- HumanEval 和 MBPP 得分接近 DeepSeek v3.1、Mistral Large

- 上下文窗口超长

- Scout 模型支持最长 10,000,000 tokens(远超 GPT-4o 的 128K)

- 适合文档总结、RAG 检索增强等场景

- 效率与部署优势明显

- MoE 架构推理成本更低,单卡可运行 Scout

- Maverick 支持多云部署、企业级集成

Llama 4 下载与体验方式

Llama 4 Scout 与 Maverick 均已开放权重下载,支持 Hugging Face、llama.com、自部署、多云部署,已集成于 Meta AI 产品(WhatsApp、Messenger、Instagram Direct)

- 在线体验:https://meta.ai/

- 下载地址:https://www.llama.com

- Hugging Face 页面:Llama 4 Models